Die Kooperation zwischen Mirantis und VAST Data bereichert das k0rdent AI Ökosystem um eine standardisierte Integrationsschicht für VAST Cosmos. Neocloud-Betreiber profitieren von wiederholbaren Kubernetes-nativen Deployment-Mustern, die heterogene GPU-Cluster und Speicherkomponenten verknüpfen. Durch automatisierte Workflows sinkt der Aufwand für komplexe Multi-Vendor-Stacks deutlich. Gleichzeitig verhindert die integrierte Dateninfrastruktur von VAST Data Storage-Engpässe, steigert den Datendurchsatz und maximiert die GPU-Auslastung für reibungslose KI-Services. Das Ergebnis sind beschleunigte Bereitstellungen sowie optimierte Infrastrukturkosten und Skalierungseffizienz.

Inhaltsverzeichnis: Das erwartet Sie in diesem Artikel

Mirantis und VAST Data beschleunigen Bereitstellung von leistungsstarken KI-Services

Mirantis erweitert sein k0rdent AI Ökosystem durch die offizielle Technology Partnership mit der VAST Cosmos Community von VAST Data. Ziel ist ein standardisierter Integrationspfad, der das VAST KI-Betriebssystem in Kubernetes-native Deployments einbettet. Betreiber können so Compute, Netzwerk und Storageressourcen flexibel kombinieren und erprobte NVIDIA-Referenzarchitekturen nutzen. Der modulare Ansatz minimiert individuelle Integrationsrisiken, beschleunigt Inferenz-Workflows und maximiert die GPU-Auslastung in Multi-Vendor-Umgebungen. Diese Lösung unterstützt dynamische Datendienste für Training, Inferenz und agentenbasierte KI-Anwendungen.

Offene k0rdent Architektur kombiniert Compute Netzwerk Storage mit VAST

Mirantis integriert das VAST KI-Betriebssystem gemeinsam mit VAST Data über einen einheitlichen, normbasierten Pfad in die k0rdent AI Plattform. Dieses Vorgehen minimiert individuelle Anpassungen durch wiederholbare Abläufe und gewährleistet Konsistenz in Multi-Vendor-Umgebungen. Dank der offenen k0rdent-Architektur lassen sich Ressourcen wie GPU-Cluster, Netzwerke und Storage flexibel kombinieren. VAST Data sorgt parallel für dynamische, latenzarme Datendienste, die den Durchsatz steigern und Engpässe in KI-Workloads vermeiden. So entstehen wiederholbare, automatisierte Deployments ohne Manuelleingriffe.

Neocloud-Betreiber maximieren jetzt GPU-Auslastung dank effizienter automatisierter Integrationsprozesse weltweit

Kevin Kamel, Vice President of Product Management bei Mirantis, weist darauf hin, dass Neocloud-Betreiber ihre GPU-Kapazitäten unter hohem Zeitdruck effizient orchestrieren müssen. Durch das partnerschaftliche Zusammenspiel entfallen manuelle und fehleranfällige Integrationsschritte, was die Einführung neuer KI-Services deutlich beschleunigt. Operative Teams gewinnen Freiräume, um sich auf Performance-Tuning und Service-Optimierung zu fokussieren. So lässt sich die Bereitstellung hochskalierbarer KI-Infrastrukturen effizienter gestalten und Engpässe lassen sich proaktiv verhindern. Die Time-to-Market verkürzt sich spürbar.

Neuer KI-Stack steigert Performance von Training bis agentischer Inferenz

Speicher- und Datenpipeline-Engpässe sind oft der Flaschenhals in High-End-KI-Architekturen, wodurch teure GPU-Instanzen nicht vollständig genutzt werden können. VAST Data implementiert ein flexibles Datendienst-Framework, das alle Workload-Phasen von Training über Inferenz bis hin zu autonomen Agenten abfedert und so Durchsatz und Performance verbessert. Zusammen mit k0rdent AI entsteht ein integrierter Software-Stack, der Datenzugriff, Speicher-IO und GPU-Auslastung intelligent orchestriert und signifikante Effizienzsteigerungen ermöglicht. Das führt zu reduzierten Betriebskosten, höherer Skalierbarkeit und Zuverlässigkeit.

Effiziente Kombination Compute Netzwerk und Storage sichert hohe Vorhersehbarkeit

Im Rahmen ihrer Kooperation unterstützen Mirantis und VAST Data eine Reihe von Referenzarchitekturen, die von NVIDIA geleitet werden und speziell auf den Einsatz umfangreicher GPU-Clustern ausgerichtet sind. Diese Blaupausen definieren genaue Leitlinien für die Kombination von Compute-Knoten, Netzwerkinfrastruktur und Speichersystemen. Mit geprüften, standardisierten Komponenten anstelle individueller Setups erhalten Betreiber konsistente Sicherheitsstandards, reproduzierbare Leistungsprofile und eine klare Planbarkeit von Wartung sowie zukünftigen Erweiterungen. Sie steigern Effizienz, Stabilität sowie Skalierbarkeit und Kostentransparenz.

Automatisierte k0rdent-Workflows steigern GPU-Auslastung und vereinfachen globale KI-Infrastrukturoperationen effizient

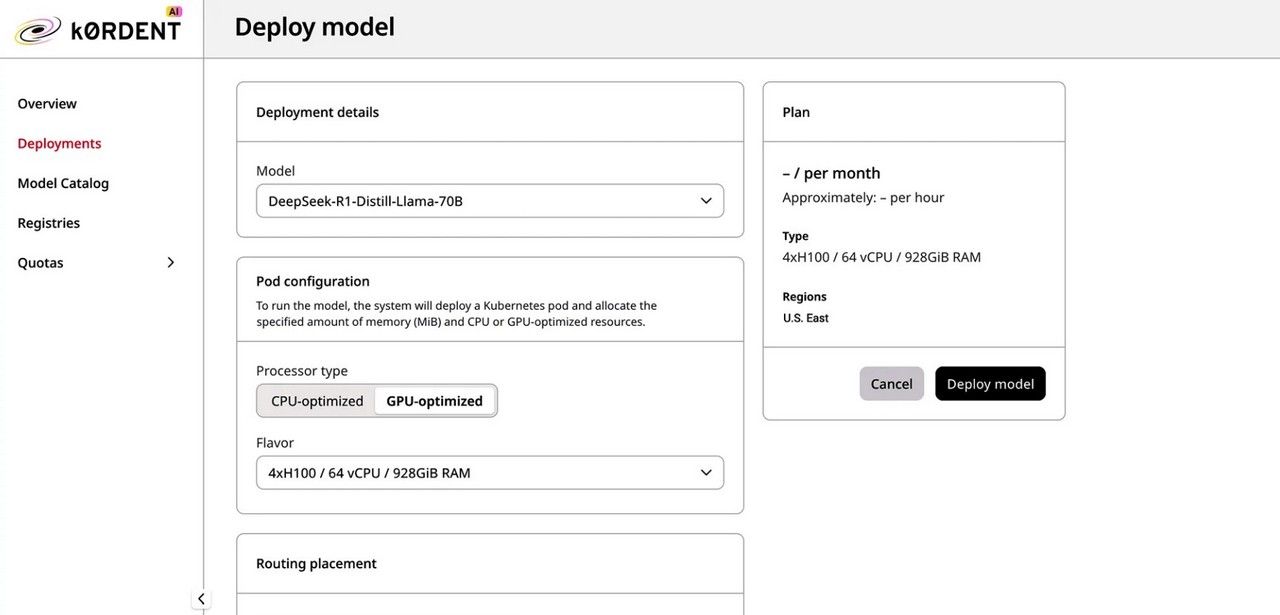

Für Betreiber von GPU-Clouds stellt k0rdent eine praxiserprobte Basis bereit, um KI-Infrastrukturen auf Kubernetes zu implementieren. Vordefinierte Deployment-Muster standardisieren Abläufe und reduzieren individuelle Integrationsaufwände drastisch. Die native Automatisierung übernimmt Konfigurations-, Überwachungs- und Skalierungsfunktionen, um Ressourcen in Echtzeit optimal bereitzustellen. Diese End-to-End-Orchestrierung steigert die GPU-Auslastung signifikant und ermöglicht elastisches Wachstum von KI-Diensten. Gleichzeitig profitieren Teams von höherer Wiederholbarkeit, geringeren Betriebskomplexitäten und messbar beschleunigten Release-Zyklen. Rollout-Prozesse adaptieren automatisch auf variable Workload-Spitzen. skaliert.

Neoclouds profitieren von validierten Referenzarchitekturen dank effizienter Kubernetes-nativer Automatisierung

Mit der Integration von Mirantis k0rdent AI und VAST Data Plattform erhalten Neocloud-Betreiber eine schlüsselfertige Lösung, die Daten-Pipeline-Engpässe vermeidet und den Datendurchsatz durchgängiger AI-Workloads maximiert. Standardisierte Schnittstellen und automatisierte Deployment-Muster reduzieren manuelle Eingriffe und beschleunigen die Markteinführung neuer KI-Services. Die optimierte GPU-Auslastung senkt Betriebskosten und steigert die Effizienz, während validierte Referenzarchitekturen für hohe Verlässlichkeit sorgen und redundante Komplexität in heterogenen Multi-Vendor-Umgebungen eliminieren. Sie bieten robuste Sicherheit, Skalierbarkeit und flexible dynamische Ressourcenzuweisung.